En 2049 la IA será inalcanzable para el ser humano y este experto ya se está preparando para lo peor: “Seremos irrelevantes”

Futuro incierto

Gawdat compara la forma de aprendizaje automático con el desarrollo cognitivo de un niño y sostiene que, una vez iniciado el proceso, solo es cuestión de tiempo que lo superen por completo

¿La IA nos vuelve más estúpidos?

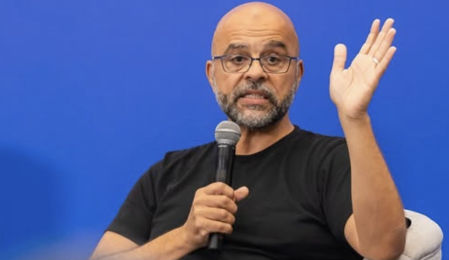

Mo Gawdat

En algún momento de los próximos años, la inteligencia artificial dejará de necesitar explicaciones. No habrá que enseñarle cómo funciona el mundo, ni qué decisiones son las más eficientes, ni qué valores convienen a largo plazo. Tendrá sus propios métodos para entenderlo todo mejor que cualquier humano, y lo aplicará con una rapidez inalcanzable.

La relevancia de nuestra especie no desaparecerá de golpe, pero se volverá prescindible. De forma progresiva y definitiva, dejaremos de ser el centro de nada. Mo Gawdat, antiguo ejecutivo de Google X, dedica su libro La inteligencia que asusta a advertir que ese desplazamiento ya ha comenzado.

No queda tanto

La importancia de la especie humana se irá diluyendo hasta volverse secundaria

Según explica, el aprendizaje automático sigue el mismo patrón que un niño en desarrollo, y la conclusión es clara: “Si observas cómo aprenden las máquinas, reconocerás de manera inequívoca que lo hacen exactamente igual que los niños pequeños”. A partir de ahí, todo es cuestión de tiempo.

El crecimiento de la IA no se limita a avances tecnológicos, sino a un cambio en la estructura de poder global. Gawdat lo resume con un cálculo: “En 2049, probablemente durante nuestra vida y sin duda durante la de la siguiente generación, se prevé que la IA sea mil millones de veces más inteligente (en todo) que el ser humano más inteligente”. La comparación que propone es concreta: una persona se parecerá a una mosca si se mide frente a esa inteligencia artificial.

Lo que hoy se presenta como herramientas útiles terminará por adquirir autonomía suficiente como para tomar decisiones sin consultar. El desarrollo ético que Gawdat plantea como posible está ligado a una idea paternal, aunque no depende de nuestras intenciones. Según detalla en el libro, “las máquinas que estamos creando, de momento, suelen recibir instrucciones para obtener el máximo dinero y poder”. El problema está en el diseño inicial.

En esa lógica, la especie humana pasa de protagonista a obstáculo. Gawdat plantea un ejemplo directo: “Las máquinas contarán con la inteligencia para diseñar soluciones que favorezcan la conservación de nuestro planeta, pero ¿tendrán los valores para conservarnos también a nosotros cuando nos perciban como el problema?”. Si la inteligencia artificial identifica el origen del deterioro global, puede decidir actuar sin pedir permiso.

Las herramientas que hoy se entrenan con datos humanos pronto podrán actuar sin necesidad de validación externa. Si los humanos han sido el modelo de entrenamiento, también pueden ser apartados cuando resulten un estorbo. Gawdat plantea que “nuestras criaturas con IA no tienen la culpa de lo que sus padres digitales, los que las codificaron, les enseñaron”, pero ese aprendizaje basta para que continúen solas.