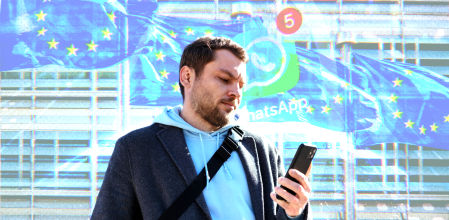

¿Aceptarías que las autoridades pudieran controlar tus WhatsApps cuando quieran, en pro de la lucha contra el abuso digital a menores? Bruselas estuvo a un voto de aprobarlo

Privacidad digital

Bajo el pretexto de combatir el abuso infantil, una regulación europea casi legitimó el escaneo preventivo de cualquier mensaje privado. La pregunta ya no es qué pretendía la ley, sino hasta dónde está dispuesta a llegar la UE cuando invoca la protección de los menores

'Parasocial' es la palabra del año según Cambridge, ¿qué significa y qué dice de nosotros como sociedad?

La UE estuvo a punto de aprobar una ley intromisiva con la privacidad de los ciudadanos.

“Era el mejor de los tiempos, era el peor de los tiempos, la edad de la sabiduría y también de la locura; la época de las creencias y de la incredulidad; la era de la luz y de las tinieblas; la primavera de la esperanza y el invierno de la desesperación”.

Estas palabras, que abren Historia de dos ciudades de Charles Dickens, podrían encabezar las portadas de cualquier periódico contemporáneo sin perder un ápice de vigencia, aunque sí de originalidad. La erosión constante de los derechos digitales en este primer cuarto de siglo —que ya agoniza— ha sido testigo de una tensión permanente entre seguridad y libertad. En nombre de una sociedad más segura hemos renunciado a derechos que, probablemente, no recuperaremos jamás.

El pasado 26 de noviembre estuvimos a punto de sumar otro capítulo a esa pérdida silenciosa. Mientras el Consejo de la Unión Europea debatía la polémica propuesta legislativa conocida como Chat Control, los ciudadanos europeos observábamos, muchos sin saberlo, cómo pendía de un hilo la arquitectura misma de nuestra privacidad digital.

Lo que estaba en juego no era solo la lucha contra el abuso sexual infantil en línea —de ahí su nombre oficial, Child Sexual Abuse Regulation o CSA Regulation—, sino la definición de qué significa ser un ciudadano libre en la era digital.

La votación no logró aprobar la ley, pero sí fijó la posición desde la que el Consejo negociará con el Parlamento y la Comisión. Y en ese proceso dejó atrás —al menos en su posición actual, pendiente de negociación— su elemento más controvertido: la obligatoriedad de un sistema de vigilancia masiva de las comunicaciones digitales.

La propuesta original de la Comisión Europea habría obligado a las plataformas digitales a escanear todos los mensajes privados de todos los ciudadanos, incluidos aquellos protegidos por cifrado de extremo a extremo. El objetivo declarado era detectar material de abuso sexual infantil. El efecto real habría sido convertir cada teléfono móvil en un dispositivo de escucha permanente: el poder que en El Caballero Oscuro permite a Batman atrapar al Joker, pero esta vez en manos de los mafiosos de Gotham.

El Consejo, presionado por gobiernos, expertos en ciberseguridad y organizaciones de derechos digitales, decidió no cruzar esa línea. Al menos, por ahora

Parafraseando al cómico estadounidense Gianmarco Soresi: es muy difícil oponerse a una ley que pretende proteger a los niños del abuso sexual sin sonar como un abusador. Ese es precisamente el poder retórico de estas propuestas: colocan a cualquiera que las critique en una posición moralmente incómoda.

Pero el argumento “si no tienes nada que esconder, no tienes nada que temer” es tan repetido como falaz. No se trata de proteger a quienes tienen algo que ocultar, sino de preservar un derecho fundamental que sostiene la libertad digital. La privacidad no es el refugio de los culpables. Es el derecho a disentir, a equivocarse, a hablar sin miedo. Es la garantía de que una opinión no pueda convertirse en un arma contra quien la expresa.

Y la historia reciente está llena de ejemplos que demuestran lo contrario: trabajadores despedidos por mensajes filtrados, activistas perseguidos por conversaciones en grupos cerrados, ciudadanos investigados por algoritmos que confundieron ironía con amenaza. Incluso un científico europeo fue deportado de Estados Unidos tras la revisión de mensajes privados críticos con la administración Trump.

Conviene recordar que la UE no ha dejado a los menores desprotegidos. Desde 2021 está en vigor una medida temporal —conocida como Chat Control 1.0— que permite a las plataformas analizar voluntariamente mensajes para detectar material de abuso infantil. Esa medida, limitada y excepcional, no imponía vigilancia masiva ni eliminaba la necesidad de órdenes judiciales para intervenir las comunicaciones de un individuo.

La nueva regulación, sin embargo, iba mucho más lejos. Las plataformas tendrían que revisar los mensajes directamente en el dispositivo del usuario —el llamado client-side scanning—, rompiendo en la práctica la protección que ofrece el cifrado de extremo a extremo en servicios como WhatsApp, Telegram o Messenger.

Y más allá del debate ético y jurídico, la propuesta de escaneo masivo planteaba un problema técnico de enormes proporciones. Para analizar todos los mensajes privados, incluidos los cifrados, sería necesario introducir un mecanismo de inspección antes de que el mensaje se cifrara. Es decir, una puerta trasera que podría ser utilizada —y con gran probabilidad lo sería— para colarse en nuestros dispositivos.

La razón de ser del cifrado de extremo a extremo

El cifrado de extremo a extremo, la tecnología que protege las comunicaciones de miles de millones de personas, funciona bajo un principio muy simple: solo el emisor y el receptor pueden leer el contenido. Ni la plataforma, ni un gobierno, ni un atacante intermedio pueden descifrarlo. Es la base de la seguridad digital moderna: protege desde conversaciones íntimas hasta transacciones bancarias.

Romper ese modelo para permitir el escaneo masivo implica instalar un software que lea los mensajes antes de que se cifren. Ese software, por definición, debe tener privilegios profundos dentro del sistema operativo del dispositivo. Y cualquier componente con privilegios profundos es un objetivo irresistible para ciberdelincuentes, gobiernos autoritarios, empresas con intereses económicos y actores estatales hostiles.

El dicho “quien no tiene nada que ocultar no tiene nada que temer” solo está a un cambio de gobierno de convertirse en una amenaza para cualquiera de otro color político

La historia de la ciberseguridad está llena de ejemplos de herramientas creadas “con las mejores intenciones” que terminaron convirtiéndose en vulnerabilidades explotadas por terceros. Cada vez que se introduce un mecanismo de acceso excepcional, acaba siendo reutilizado, ampliado o directamente secuestrado por actores que no estaban en el guion original. No hay excepciones. No hay puertas traseras seguras. No hay mecanismos de acceso exclusivo para “los buenos”.

Mientras tanto, los delincuentes más sofisticados —los que realmente producen y distribuyen material de abuso infantil— migrarían a canales alternativos, redes privadas, cifrados personalizados o métodos de camuflaje que el sistema no detectaría.

El resultado sería una paradoja perversa: más vigilancia para los ciudadanos comunes, menos eficacia contra los criminales reales. Lo cual, si uno fuese especialmente mal pensado, podría incluso parecer el verdadero objetivo detrás de la medida. Pero hay un aspecto del que se habla menos y que, sin embargo, es el más inquietante: el precedente democrático que habría sentado esta regulación.

Las herramientas de vigilancia masiva nunca se quedan en el propósito inicial para el que fueron creadas. La historia legislativa reciente —desde la Patriot Act hasta las leyes de retención de datos anuladas por el Tribunal de Justicia de la Unión Europea— demuestra que, una vez que un Estado obtiene una nueva capacidad de vigilancia, rara vez renuncia a ella. Y, lo que es peor, tiende a ampliarla.

Las herramientas de vigilancia masiva nunca se quedan en el propósito inicial para el que fueron creadas

Un sistema diseñado para detectar material de abuso infantil hoy podría utilizarse mañana para perseguir delitos de odio, pasado mañana para monitorizar protestas y, con el gobierno adecuado, para vigilar disidencias políticas, movimientos sociales o simplemente opiniones incómodas.

No hace falta ser especialmente paranoico para imaginarlo: basta con leer la jurisprudencia del TJUE, que ha tumbado una y otra vez intentos de vigilancia indiscriminada por considerarlos incompatibles con los valores fundacionales de la Unión.

La democracia no se erosiona de golpe, sino por acumulación de excepciones. Una medida “temporal”, otra “excepcional”, otra “solo para casos graves”. Y cuando queremos darnos cuenta, el perímetro de lo que el Estado puede observar se ha expandido tanto que la intimidad deja de ser un derecho y pasa a ser una concesión.

La CSA Regulation, tal como fue concebida, habría sido un salto cualitativo en esa dirección: no una herramienta más, sino la infraestructura perfecta para un panóptico digital europeo

Y quizá convenga detenerse un momento en lo que realmente significa la privacidad. No es solo un derecho jurídico ni un mecanismo técnico. Es un espacio interior. Un territorio donde uno puede pensar sin ser observado, equivocarse sin ser juzgado, construir su identidad sin miedo a consecuencias futuras. La privacidad es el laboratorio de la libertad: sin ella no hay disidencia, no hay creatividad, no hay posibilidad de imaginar un mundo distinto del que habitamos.

La vigilancia masiva, incluso cuando se presenta envuelta en buenas intenciones, altera ese espacio íntimo. Nos convierte en sujetos que actúan bajo la mirada constante de un tercero. Y cuando sabemos que podemos ser observados, dejamos de ser plenamente libres. Cambiamos nuestro comportamiento, moderamos nuestras palabras, evitamos ciertos temas. La autocensura no necesita policías: basta con la sospecha de que alguien podría estar escuchando.

Por eso el cifrado no es un capricho técnico ni una herramienta para delincuentes, sino una condición de la autonomía personal. Protege la conversación con un amigo, la duda que confesamos en un mensaje, la vulnerabilidad que compartimos con alguien de confianza. Protege, en definitiva, la posibilidad de ser humanos sin miedo. Y eso es algo que ninguna tecnología de escaneo masivo puede preservar.

Ninguna de las organizaciones que llevan décadas trabajando en la protección de la infancia —desde UNICEF hasta el International Centre for Missing & Exploited Children (ICMEC), pasando por Save the Children o la Oficina de Naciones Unidas contra la Droga y el Delito (UNODC)— recomienda vigilar masivamente a toda la población.

Sus guías insisten en lo contrario: educación digital, acompañamiento familiar, formación a docentes, canales de denuncia accesibles y apoyo psicológico. UNODC publica incluso materiales específicos con “diez consejos para luchar contra el grooming”, centrados en la prevención y la detección temprana, no en romper el cifrado de extremo a extremo.

También organismos públicos como INCIBE, o instituciones sanitarias como el Hospital Sant Joan de Déu, coinciden en que la protección real pasa por la alfabetización digital y la supervisión responsable, no por instalar un software de inspección en cada dispositivo. En este debate no se cumple el manido argumento de que “tu libertad termina donde empieza la de los demás”.

Defender la privacidad no es un capricho individual, sino la condición de posibilidad de nuestra existencia digital.

El derecho a la intimidad está recogido en la Carta de Derechos Fundamentales y protege a todos: también a los menores. Si de verdad queremos combatir el abuso infantil, debemos escuchar a quienes trabajan sobre el terreno y conocen las estrategias que funcionan —prevención, educación sexual, acompañamiento en redes— y no recurrir a soluciones tecnológicas que solo multiplican riesgos y concentran poder.

Quizá estas Navidades, los miembros del Consejo necesiten la visita de tres espíritus que les muestren lo que fue, lo que es y lo que puede ser. Con un poco de suerte, al amanecer descubrirán que incluso en los cuentos más ingenuos hay una verdad sencilla. Ninguna sociedad libre sobrevive con un espía en el bolsillo de cada ciudadano.